1月29日,总部位于美国的WIZ Research宣布,它负责任地披露了以前向公众开放的DeepSeek数据库,揭示了聊天日志和其他敏感信息。 DeepSeek锁定了数据库,但这些发现通过生成的AI模型(尤其是国际项目)突出了可能的风险。

DeepSeek在上周震撼了科技界中国公司的AI模型与美国生成的AI领导者竞争。特别是,DeepSeek的R1在某些基准测试中与OpenAI O1竞争。

Wiz Research如何发现DeepSeek的公共数据库?

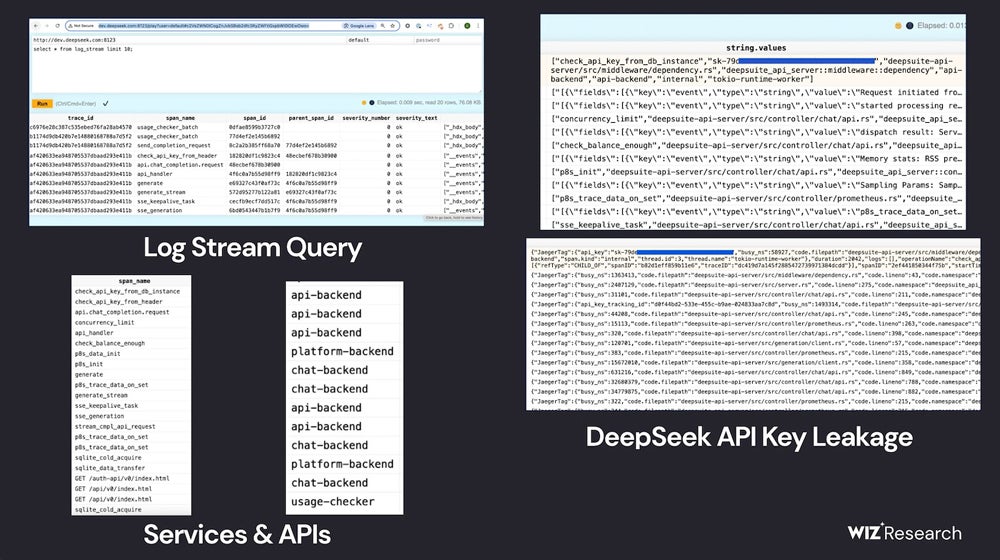

在披露Wiz Research的工作的博客文章中,云安全研究人员Gal Nagli详细介绍了该团队如何找到一个属于DeepSeek的公共可访问的点击室数据库。该数据库为控制数据库和特权升级攻击打开了潜在的路径。在数据库内,WIZ研究可以阅读聊天历史记录,后端数据,日志流,API秘密和操作细节。

当他们评估了DeepSeek的潜在漏洞时,该团队在“几分钟之内”发现了Clickhouse数据库。

纳格利在给TechRepublic的一封电子邮件中说:“我们感到震惊,并且考虑到这一发现的幅度,我们也感到非常紧迫的行动。”

他们首先评估了DeepSeek面向互联网的子域,两个开放式港口将它们击中不寻常。这些端口导致DeepSeek的数据库托管在开源数据库管理系统Clickhouse上。通过在Clickhouse中浏览桌子,Wiz Research找到了聊天历史记录,API键,操作元数据等。

WIZ研究小组指出,根据道德研究实践,他们在勘探过程中没有“执行侵入性查询”。

Wiz Research向DeepSeek告知了违规行为,而AI公司锁定了数据库;因此,DeepSeek AI产品不应受到影响。

但是,数据库可能仍然对攻击者开放的可能性突出了确保保护的复杂性生成的AI产品。

Nagli在博客文章中写道:“尽管AI安全的大部分关注都集中在未来派威胁上,但真正的危险通常来自基本风险 - 例如意外的外部曝光数据库。”

IT专业人员应该意识到采用新的和未经测试的产品,尤其是生成AI的危险,这使研究人员有时间在系统中查找错误和缺陷。如果可能的话,在公司中包括谨慎的时间表生成的AI使用政策。

看:保护和保护数据在生成AI时代,已经变得更加复杂。

Nagli说:“当组织急于从越来越多的初创公司和提供商那里采用AI工具和服务时,必须记住,这样做是至关重要的,我们将使用敏感数据委托这些公司。”

根据您的位置,IT团队成员可能需要了解可能适用于中国生成的AI模型的法规或安全问题。

“例如,模型并非透明或全面地提出中国历史上的某些事实。”数据科学公司Tredence Gen Gen Gen Kulkarni指出,他在发送给TechRepublic的电子邮件中。 “调用托管模型的数据隐私影响也不清楚,大多数全球公司都不愿意这样做。但是,应该记住,DeepSeek模型是开源的,可以在公司的私有云或网络环境中进行本地部署。这将解决数据隐私问题或泄漏问题。”

当Tech Republic通过电子邮件与他联系时,Nagli还建议使用自托模型。

他写道:“实施严格的访问控件,数据加密和网络细分可以进一步减轻风险。” “组织应确保他们对整个AI堆栈具有可见性和治理,以便他们可以分析所有风险,包括使用恶意模型,培训数据的暴露,培训中的敏感数据,AI SDKS中的脆弱性,AI服务的漏洞,其他有毒攻击者可能利用的风险组合。”